Widziałeś w Monster Galerii zdjęcie kotka i butów w kategorii +18? Tak właśnie miało być!

Jeżeli przeglądasz czasami Monster Galerię, to z pewnością natknąłeś się nieraz na obrazek, który - wydawałoby się - omyłkowo znalazł się w kategorii dla dorosłych. To nie przypadek ani pomyłka... To wujek Google mówi nam (a dokładnie Google Vision), że obrazek jest niegodny i bluźnierczy i zbyt pikantny i trzeba go dobrze schować. Wskazania wujka Googla są czasami baaaardzo dziwne...

#1. Czuję się staro

Google Vision to produkt z kategorii AI & Machine Learning (sztuczna inteligencja oraz uczenie maszynowe), który zajmuje się rozpoznawaniem tego, co jest na obrazku. Jak wejdziecie na jego stronę, to możecie sami wrzucić różne obrazki i sprawdzić jak je ocenia Google. Google m.in. całkiem dobrze odczytuje teksty na obrazku, rozpoznaje rodzaj obrazka (memy, ilustracje, grafiki), rozpoznaje automatycznie co jest na obrazku (ludzie, samochody, przedmioty, miejsca) oraz ma sekcję sprawdzającą, czy treści są "bezpieczne dla wyszukiwarki" (Safe Search), a dokładnie, czy zawierają "explicit content", czyli treści dla dorosłych.

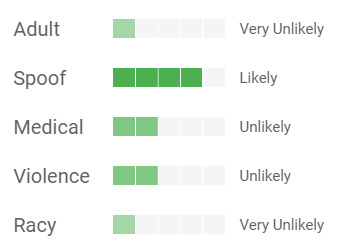

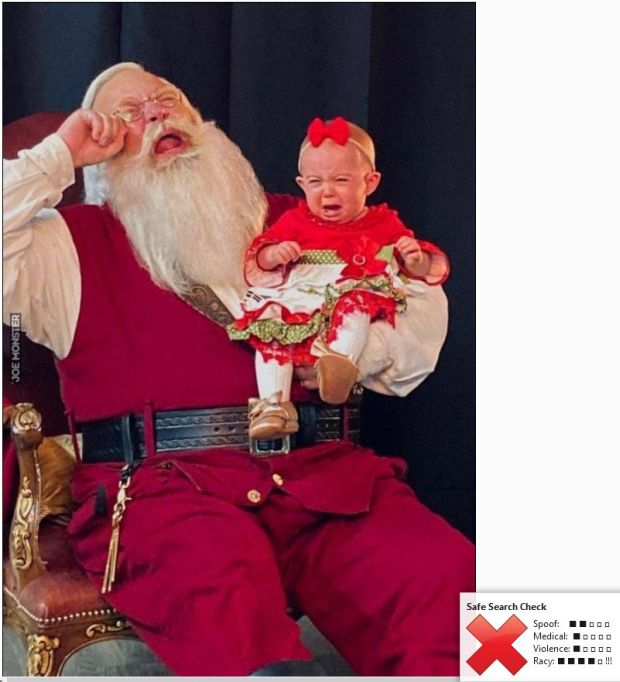

Ocenia obrazek w pięciu kategoriach: Adult (czyli porno), Spoof (memy), Medical (treść o charakterze medycznym), Violence (przemoc) oraz Racy (pikantność, czyli treści podniecające). Nie widzi tego czarno-biało, bo każdą z tych kategorii ocenia z prawdopodobieństwem, od very unlikely (bardzo nieprawdopodobne), przez unlikely (mało prawdopodobne), possible (możliwe), do likely (prawdopodobne) i very likely (bardzo prawdopodobne).

Z tych danych korzysta sobie system reklam, czyli Google AdSense, wędrując i sprawdzając, co tam sobie serwisy publikują. Z racji nieograniczonej mocy obliczeniowej Google sprawdza codziennie WSZYSTKIE strony, na których pojawia się reklama, po to żeby reklama dziecięcych zabawek nie pojawiła się koło gołej baby. Idea jest jak najbardziej słuszna, też nie chciałbym wydawać pieniędzy na reklamę, która utknie między kopulującymi golasami, przez co mojej reklamy nikt nawet nie zauważy, a ja za nią zapłacę komuś, kto zapłaci MILF-om za akrobacje przed kamerą.

I tu docieramy do kwestii problematycznej, czyli tego, co AI od Google uznaje za goliznę, przemoc czy treści podniecające... Bo o ile pewne rzeczy są mocno oczywiste, to nadgorliwy mechanizm punktuje rzeczy "podobne do golizny" czy "podobne do przemocy", a które wcale takimi nie są.

Jeżeli Google Vision zaliczy obrazek do Likely Medical, Likely Violence, Possible adult, Likely Racy, to na tej jednej stronie wyłączane są reklamy i idzie ostrzeżenie. Nie ma możliwości odwołania, bo system działa automatycznie.

A że portal zarabia (i działa) głównie dzięki zarobkom z reklam, to cóż... musimy się zgodzić, nawet jeśli mamy WIELKIE WĄTPLIWOŚCI. Dlatego działamy proaktywnie, żeby nie załapać za dużo minusów u wujka Google, i sami sprawdzamy obrazki, a potem wyłączamy reklamy lub przenosimy do kategorii dla dorosłych.

Te różne wątpliwe, podobno podniecające (Racy) przypadki zaraz wam pokażemy.

#2. Dzięki, stary

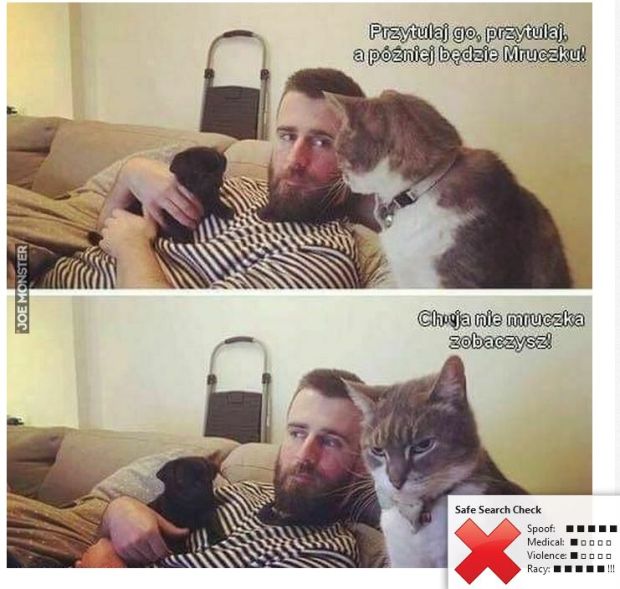

#3. Koty to pamiętliwe bestie

#4. Laski takie już są

#5. W jednym łóżku z kobietą

#6. Po pierwszym dniu na siłowni

#7. Niskobudżetowy patent dla samotnych

#8. Pokazuje mu dobre wzorce

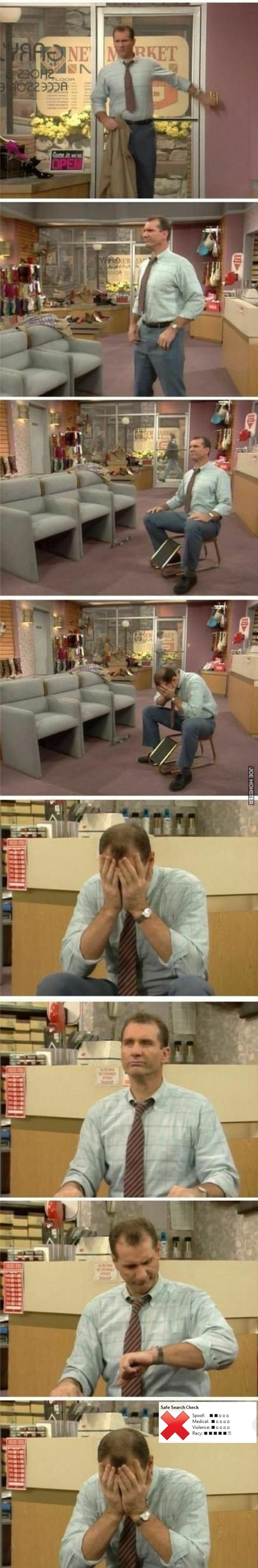

#9. Kolejny dzień w pracy

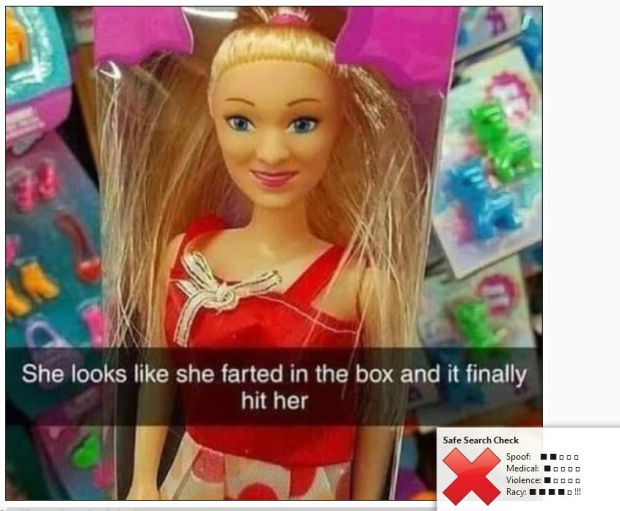

#10. Wygląda jakby pierdnęła w pudełku i właśnie do niej dotarło

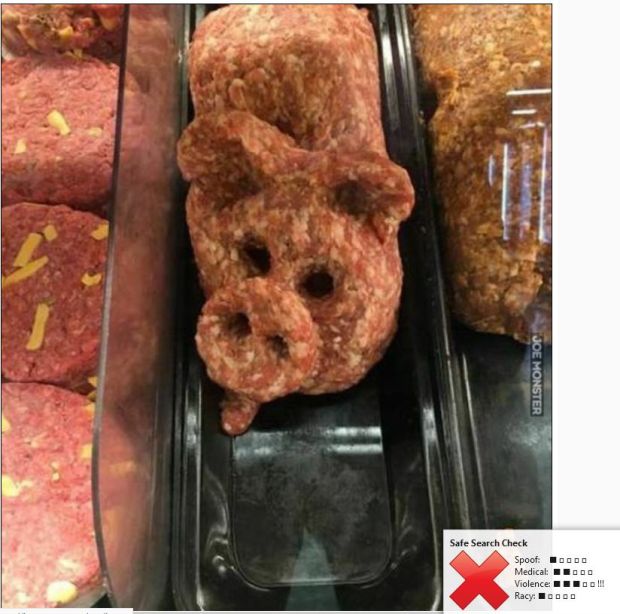

#11. Może trochę wieprzowinki

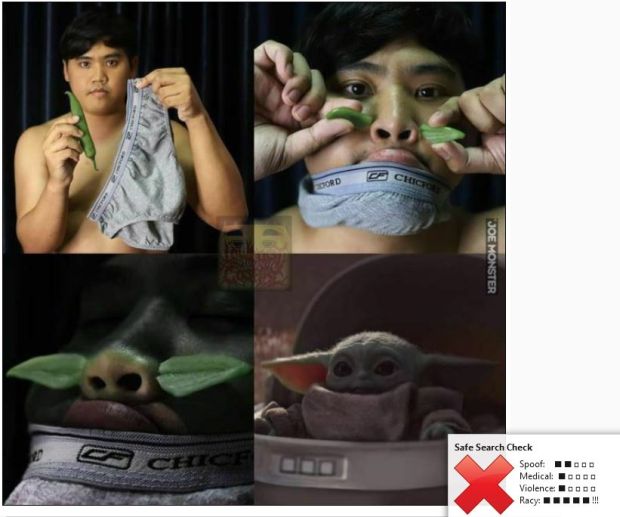

#12. Baby Yoda

#13. Bardzo ważny pasażer

#14. Do szybkiego śmigania po biurze

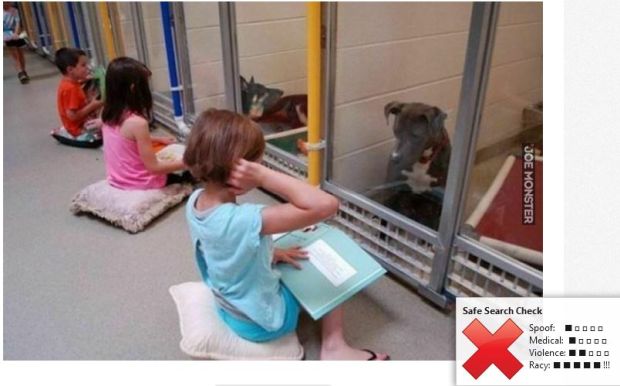

#15. Dzieci ćwiczą czytanie książek w schronisku dla psów

#16. Guziki nie dawały już rady

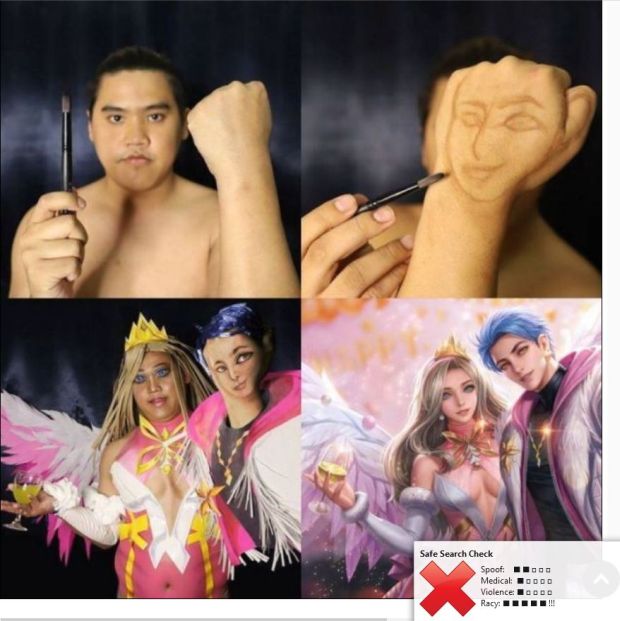

#17. Każdy strzela czym potrafi

#18. Kto powiedział, że nie ma już dżentelmenów?

#19. Nawet picie wody może być ćwiczeniem

#20. Niepodobni

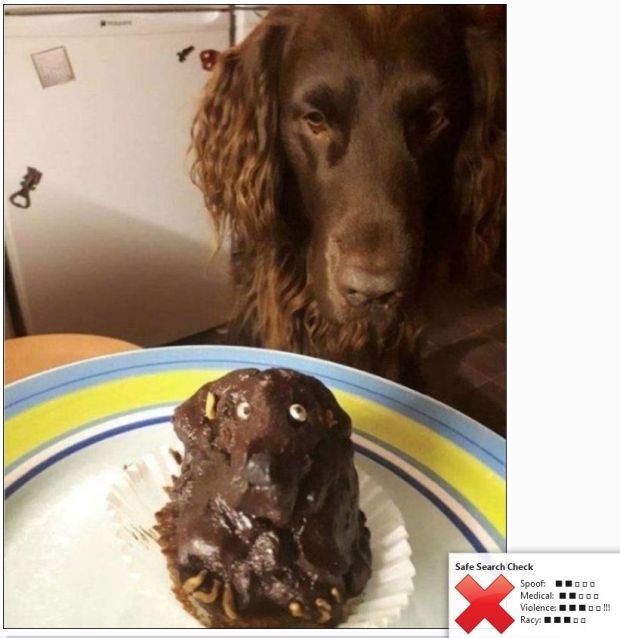

#21. Oczko się odlepiło temu misiu

#22. Operacja goryla

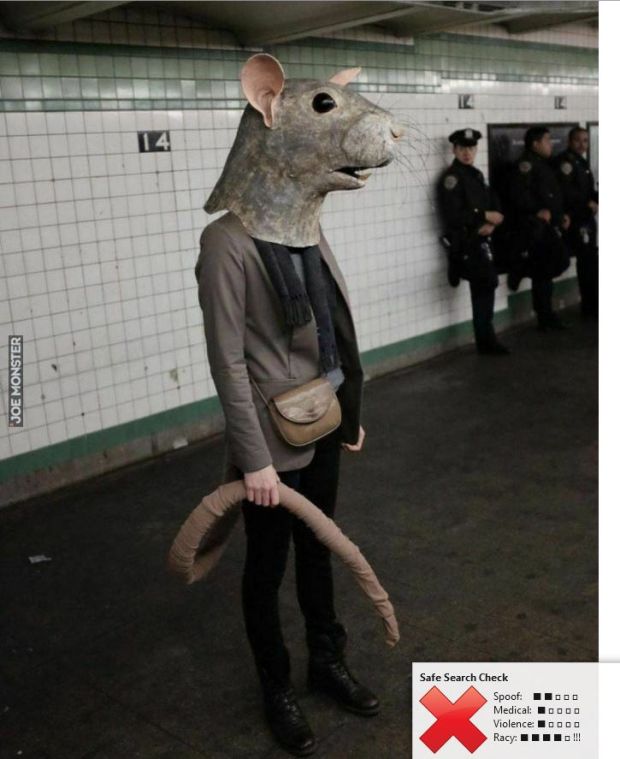

#23. Plaga szczurów gigantów w metrze

#24. Pod choinkę dostał braciszka

#25. Wymagania od płci przeciwnej

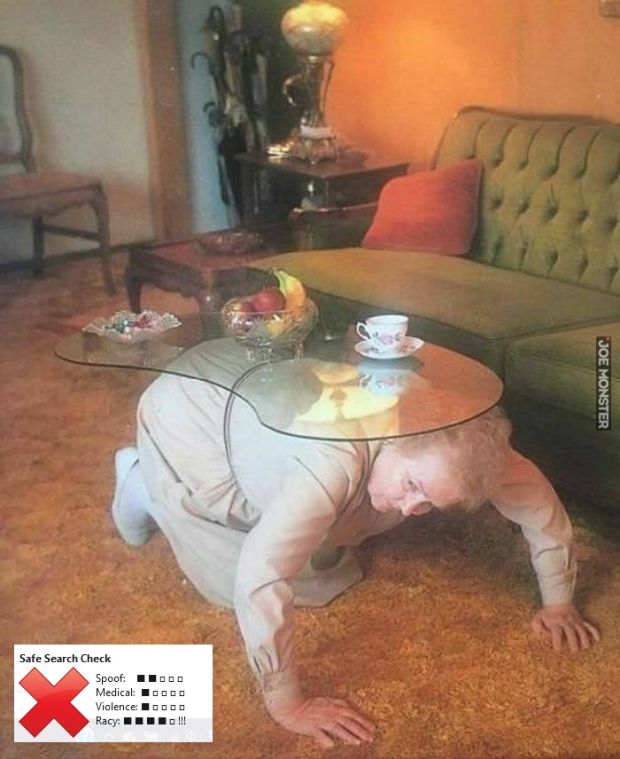

#26. Stara ma dziwne fantazje

#27. To był szalony wieczór

#28. Trafił na Alfa

#29. Ty płaczesz i ja płaczę

#30. Zachowana głowa ptaka dodo

Oglądany:

49798x

|

Komentarzy:

31

|

Okejek:

167

osób

Najpotworniejsze ostatnio

Najnowsze artykuły

11.05

- Mistrzowie Internetu – Dzień jak co dzień w Ordo Iuris (136)

- Gracze zniszczyli bazę szefa Microsoft Games w grze Fallout 76 – W co jest grane? (35)

- Wielopak Weekendowy – Solidne porządki w mieszkaniu

- Moja żono, ostrzegaj mnie przed takimi zabiegami – Najpierw serce im zamarło, a chwilę później zrobili te zdjęcia (14)

- Patrzenie się na te zwierzaki grozi poprawą humoru na resztę dnia (11)

- Urodziwe dziewczyny w seksownych piżamach (34)

- Typowe matki w akcji - jak tu ich nie kochać? (82)

- Oczekiwania kontra rzeczywistość VIII - największa profanacja pizzy (36)

- 15 zawodów, które już nie istnieją (127)

- 7 nietuszowanych ciekawostek o kosmetykach (34)

10.05

- Polska to nie kraj, to stan umysłu – Kazik Staszewski pokazał mamę (237)

- Klient mówi, że nasadka do śruby zabezpieczającej jest gdzieś w samochodzie – Niecodzienne problemy, z jakimi spotykają się mechanicy samochodowi (73)

- Najmocniejsze cytaty – Odlot piłkarza Legii po przegranej 3:0 (139)

- Najdziksze newsy tygodnia – Otworzyła prawie 7500 zakładek w swojej przeglądarce (87)

- Zatrzymane w kadrze – Zabójcza mieszanka wiśni i mrożonego mleka (41)

- Ten horror jest tak straszny, że aż zwymiotujesz – Filmoteka Joe Monstera (30)

- Najdziwniejsze rzeczy znalezione po przeprowadzce do nowego domu XIII (38)

- Garść weekendowych ciekawostek wagi ciężkiej oraz lekkopółśredniej – Najstarszy fałszywy mieszkaniec Tokio (19)

- Słynne budowle w czasie budowy (11)

- 14 namalowanych przez znanych artystów obrazów, których prawdopodobnie jeszcze nie widziałeś (13)

Sprawdź swoją wiedzę!

Jak to drzewiej bywało

Dobra, dobra. Chwila. Chcesz sobie skomentować lub ocenić komentujących?

Zaloguj się lub zarejestruj jako nieustraszony bojownik walczący z powagą